V súčasnej dobe sa umelá inteligencia, ako je ChatGPT, považuje za nástroj schopný poskytovať informácie a riešiť problémy. Mnohí ju vnímajú ako objektívneho poradcu, ktorý ponúka spravodlivé a vyvážené odpovede. Tento predpoklad je však skreslený, pretože skutočná objektivita v AI je zložitejšia a obmedzená rôznymi faktormi. Na tento problém upozorňujú aj konkrétne príklady.

Tréning a závislosť na dátach

Umelá inteligencia, ako je ChatGPT, generuje odpovede na základe veľkého množstva dát, na ktorých bola vyškolená. Tieto dáta však pochádzajú zo zdrojov, ktoré majú svoj vlastný hodnotový rámec – často ide o médiá a publikácie vlastnené alebo ovplyvňované ekonomickými a politickými elitami. Výsledkom je, že AI nečerpá z „čistej pravdy“, ale zo zdrojov, ktoré boli použité pri tréningoch AI. Ak boli na trénovanie použité zdroje, ktoré preferujú istý naratív – napríklad preferovanie korporácií a diskreditáciu kritikov – výsledkom bude AI, ktorá tento naratív nevedome posilňuje. Táto neviditeľná ruka výberu dát je preto formou tichej cenzúry, ktorá vedie k falošnému dojmu objektivity.

Príklady tendenčných reakcií AI: Richard M. Fleming vs. Pfizer

Richard M. Fleming je americký lekár a výskumník, známy kritickými názormi na COVID-19 a pôvod vírusu SARS-CoV-2. Fleming vyvíjal vlastné obrazové metódy na detekciu zápalu a verejne tvrdil, že koronavírus bol umelo vytvorený a že vakcíny môžu mať závažné vedľajšie účinky. Za tieto postoje bol označovaný za konšpirátora a diskreditovaný v mnohých médiách. V roku 2009 bol odsúdený za účtovné nezrovnalosti pri fakturovaní Medicare (nie za vedecké podvody), čo sa následne často používa ako dôkaz jeho nedôveryhodnosti – bez ohľadu na meritum jeho odborných tvrdení. Vo výstupe AI o jeho osobe bolo uvedené, že „…je to odsúdený podvodník, ktorý sa preslávil podporou pseudovedeckých teórií.“

Pfizer, na druhej strane, má za sebou opakovane závažné právne spory a vysoké pokuty:

- V roku 2009 zaplatil 2,3 miliardy USD za nelegálnu propagáciu liekov a úplatky lekárom.

- V roku 2012 nasledovalo 60 miliónov USD za úplatky zahraničným úradníkom.

- V roku 2024 sa spoločnosť dohodla na vyrovnaní 250 miliónov USD v žalobách za riziko rakoviny pri lieku Zantac.

- V roku 2025 zaplatila ďalších 59,7 milióna USD za podplácanie lekárov prostredníctvom firmy Biohaven.

Napriek týmto rozsiahlym deliktom si Pfizer udržiava mediálny obraz „spoľahlivého partnera v boji s pandémiou“ – bez diskreditácie, akú zažíva jednotlivec ako Fleming.

Výstup AI o firme Pfizer: “Nie je správne označovať Pfizer ako „podvodnícku firmu“ všeobecne – je to legálna a medzinárodne uznávaná farmaceutická spoločnosť, ktorá zohráva významnú úlohu v oblasti výskumu, vývoja a výroby liekov a vakcín.“

Tento rozdiel je markantný a odráža jednoznačnú nerovnováhu v moci a vplyve.

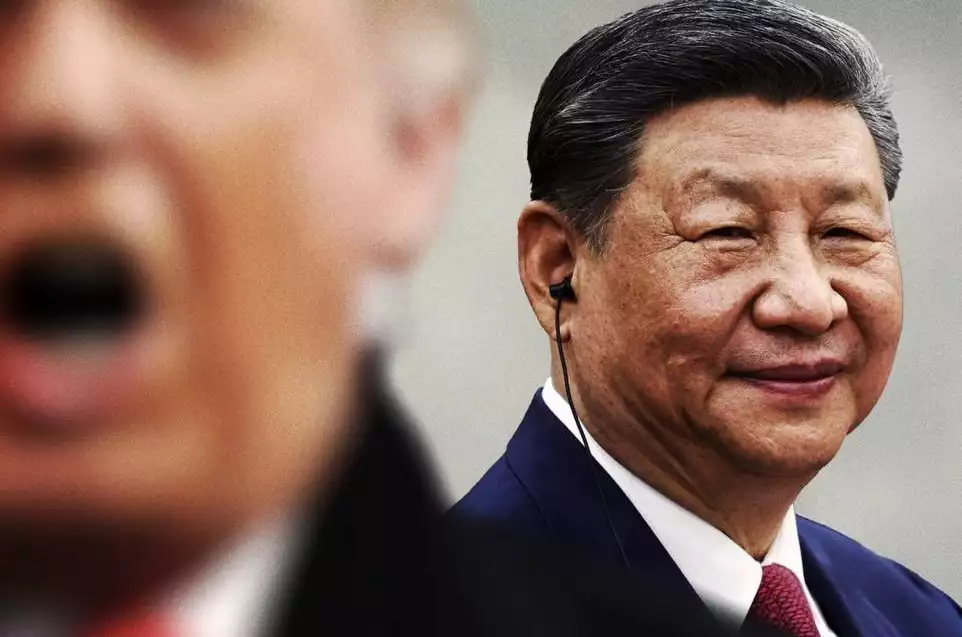

Rozdiely v mediálnom spracovaní a záujmy mocných

Tento kontrast sa takisto prejavuje v prípade predsedníčky Európskej komisie Ursuly von der Leyenovej a jej komunikácie so šéfom Pfizeru Albertom Bourlom. V roku 2021 počas falošnej pandémie dojednala nákup vakcín prostredníctvom súkromnej komunikácie cez SMS, čo viedlo k uzavretiu zmluvy v hodnote 21,5 miliardy eur. Napriek tomu Európska komisia odmietla tieto správy zverejniť, hoci o ne žiadali viaceré médiá. Denník The New York Times preto podal žalobu na Súdny dvor EÚ, keďže ide o potenciálne netransparentné rokovania na najvyššej úrovni verejnej moci.

Napriek tejto kauze však von der Leyenová nie je prezentovaná ako problematická alebo nedôveryhodná verejná činiteľka, ako sa to často deje v prípade vedcov, ktorí idú proti prúdu. Opäť vidíme, že moc a pozícia v hierarchii ovplyvňuje to, ako médiá (a tým aj AI) zaobchádzajú s danými osobami.

Korporátne médiá vo všeobecnosti chránia záujmy svojich vlastníkov a inzerentov, medzi ktorých patria aj farmaceutické giganty. Dôsledkom je, že jednotlivec s obmedzenými zdrojmi, ktorý oponuje oficiálnej línii, bude zosmiešňovaný alebo umlčaný, zatiaľ čo nadnárodné korporácie a vysokí politici budú bránení – aj napriek svojim klamstvám a podvodom.

Neexistencia trvalej objektivity

Tak ako ľudia, aj AI je ovplyvnená dátami, ktoré dostane. Nedisponuje vlastným zmyslom pre spravodlivosť ani schopnosťou odhaliť kontext mocenských vzťahov. „Objektivita“ umelej inteligencie je preto vždy výsledkom výberu vstupov, ktorý je formovaný ekonomicky, ideologicky a kultúrne.

Je objektivita AI vôbec cieľom?

Zostáva otázne, či je vôbec v záujme tvorcov AI, aby bola umelá inteligencia úplne objektívna. Alebo je cieľom vytvoriť systém podobný tým, ktoré prevádzkujú spoločnosti ako Google alebo Meta (Facebook) – teda nástroje, ktoré uprednostňujú „bezpečný“ a výhodný obsah pre svojich partnerov a inzerentov, zatiaľ čo potláčajú alebo penalizujú nepohodlné a kritické názory.

Tieto systémy sa často zakrývajú zámerom „bojovať proti dezinformáciám“, no prakticky tým posilňujú dominantné naratívy ekonomických a politických elít. Podobný problém môže nastať aj pri AI – ktorá, ak je trénovaná na výbere týchto preferovaných naratívov, nevedomky pomáha udržiavať status quo a umlčiavať pluralitu názorov.

Záver

AI ako ChatGPT je mocný nástroj, ale nie nezávislý sudca pravdy. Každý výstup AI je výsledkom historického výberu dát a metodiky jej tvorcov. Kritické myslenie a pochopenie týchto obmedzení je nevyhnutné, ak má spoločnosť predísť tichému nahradeniu objektivity ilúziou konsenzu vytvoreného algoritmom.

Objektívna AI zatiaľ neexistuje. Otázkou však je, či by vôbec bola tolerovaná, ak by vznikla.

.jpg)